I många organisationer går AI-implementationen snabbare än governance-mognaden. I takt med att verktyg som Microsoft Copilot och skräddarsydda Azure OpenAI-lösningar går från experimentfas till central affärsverksamhet har samtalet förändrats.

Governance är inte längre bara en policyfråga för juridikavdelningen – det har blivit en kritisk utmaning för ledning och säkerhet. Utan en robust governance-modell är riskerna omedelbara och operativa.

För att överbrygga det gapet vänder sig nordiska beslutsfattare mot globala standarder. Men med så många ramverk tillgängliga – vilka spelar egentligen roll i en Microsoft-orienterad miljö?

Topp 3 globala standarder för AI governance

Tre ramverk är särskilt användbara eftersom de löser olika delar av governance-problemet. Tillsammans täcker de governance-struktur, risktänkande och AI-specifik säkerhetsexponering. Var för sig lämnar de ändå viktiga luckor.

NIST AI Risk Management Framework (NIST AI RMF)

NIST AI RMF är starkast som governance- och riskramverk. Det hjälper organisationer att bygga ett gemensamt språk för att diskutera AI-risk, förtroende, ansvarsskyldighet och tillsyn – tvärs över ledning, verksamhet och teknikteam.

Dess främsta styrka är strategisk tydlighet. Det hjälper organisationer att gå från vaga idéer om "ansvarsfull AI" till en mer strukturerad diskussion om vad som ska utvärderas, övervakas och ägas. Det gör det till en stark startpunkt för organisationer som fortfarande bygger sin governance-mognad.

Begränsningen är att det stannar på en övergripande nivå. Det hjälper dig definiera hur god governance bör se ut, men det berättar inte hur du konfigurerar Purview-etiketter, granskar överdelningstrisker i Microsoft 365 eller validerar anslutna AI-applikationer i praktiken. Det bör därför ses som en strategisk grund – inte som en komplett driftsmodell.

ISO 42001

ISO 42001 är starkast som en management system-standard. Den ger organisationer en mer formell struktur för att styra AI genom definierade roller, policyer, granskningsprocesser och kontinuerlig förbättring.

Det gör den särskilt användbar för organisationer som behöver starkare managementdisciplin, tydligare ansvarsskyldighet och en governance-modell som kan skalas över tid.

Begränsningen är att det inte är en teknisk implementationsguide. Den hjälper till att skapa ordning i governance, men löser inte i sig problem som överddelning, åtkomstdesign, integrationssäkerhet eller AI-specifik testning.

OWASP Top 10 for LLM Applications

OWASP Top 10 for LLM Applications är starkast som ett säkerhetsperspektiv på AI-aktiverade system. Det fokuserar på de viktigaste riskerna i LLM- och generativ AI-applikationer, inklusive prompt injection, osäker outputhantering och bredare svagheter på applikationsnivå.

Det gör det mycket relevant för organisationer som bygger skräddarsydda AI-applikationer, integrerar LLM:er i affärssystem eller exponerar AI via API:er och anslutna arbetsflöden. Det hjälper team att testa om en AI-lösning är tillräckligt säker för verklig användning – inte bara om den är användbar.

Begränsningen är scope. OWASP hjälper med AI-säkerhet, men ger inte en komplett governance-modell för ägarskap, ledningsansvar eller enterprise-övergripande granskningsprocesser.

Nordisk AI-adoption kräver governance bortom globala standarder

Globala standarder är användbara, men de löser sällan det fullständiga problemet för nordiska organisationer. Gapet uppstår när övergripande vägledning möter regional reglering, Microsoft-tunga miljöer och den dagliga driftskomplexiteten.

I praktiken behöver nordiska organisationer mer än högnivåprinciper. De behöver governance som fungerar med lokala compliance-förväntningar, Microsoft-specifika kontroller och tydliga beslut kring ägarskap, åtkomst, tillsyn och utrullning. Standarder hjälper till att definiera riktningen, men visar inte alltid hur man kör governance i en verklig driftsmiljö.

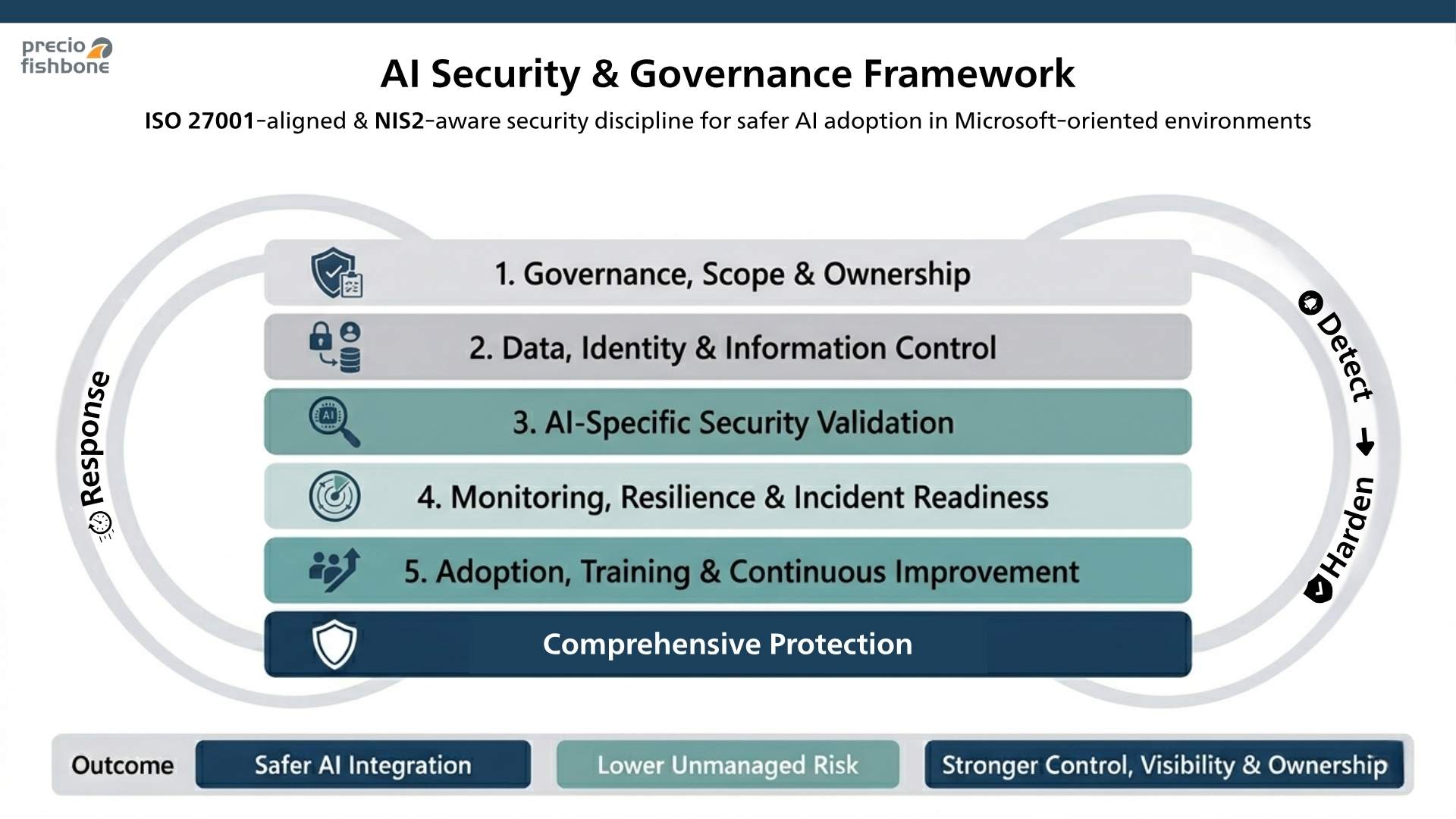

Ett praktiskt ramverk för AI governance och säkerhet

Precio Fishbones approach är bäst förstådd som en praktisk driftsmodell – inte en ny formell standard. Den är utformad för att hjälpa organisationer att använda AI säkrare i Microsoft-miljöer, genom att kombinera governance, säkerhet och operativ kontroll.

Modellen är strukturerad på ett sätt som ansluter till ISO 27001-disciplin samtidigt som den stödjer praktisk implementation i ett Zero Trust-tänk.

Governance, scope och ägarskap

Det första lagret definierar vad som ingår i scope, vem som äger beslutsfattandet och hur ansvarsskyldighet fördelas. Det inkluderar AI-användningsfall, datagränser, granskningsansvar och eskaleringsvägar. Utan det här lagret tenderar AI-adoption att glida in i isolerade affärsbeslut utan konsekvent tillsyn.

Data, identitet och informationskontroll

Det här lagret fokuserar på åtkomst, klassificering och skydd av data som används av AI. Centrala tekniker inkluderar Microsoft Entra ID för identitets- och åtkomstkontroll, samt Microsoft Purview för klassificering, känslighetsetiketter och dataskydd. Det är också här Zero Trust-principer hjälper till att minska överddelning och begränsa onödig exponering i Microsoft-miljöer.

AI-specifik säkerhetsvalidering

Det här lagret granskar om AI-anslutna applikationer, API:er och miljöer är tillräckligt säkra för verklig användning. Det inkluderar AI-säkerhetsrevisioner, integrationssäkerhetstestning och validering av anslutna Microsoft- och Azure-baserade AI-lösningar.

Övervakning, resiliens och incidentberedskap

Det här lagret förbättrar synlighet och kontroll i takt med att AI-adoptionen växer. Det fokuserar på monitoring, spårbarhet och incidentberedskap, med stöd av verktyg som Microsoft Defender, Microsoft Sentinel och Microsoft 365-säkerhet. Målet är inte bara att förebygga problem, utan att göra AI-aktivitet lättare att förstå, granska och agera på när något oväntat inträffar.

Adoption, utbildning och kontinuerlig förbättring

Det här lagret hjälper organisationer att göra governance hållbart över tid. Det fokuserar på säker adoption, riktad utbildning, granskningscykler och kontinuerlig förbättring – så att team kan använda AI med starkare kontroll och lägre ohanterad risk.

En tydligare väg till säker AI-adoption

Globala standarder för AI governance ger en viktig grund, men löser inte fullt ut den operativa utmaningen med AI-adoption. Organisationer behöver fortfarande ett praktiskt sätt att omvandla governance till tydligt ägarskap, starkare kontroller och säkrare utrullningsbeslut.

Om din organisation håller på att definiera hur AI ska styras utan att bromsa innovation kan Precio Fishbone hjälpa er att omsätta governance-förväntningar till praktiska kontroller för verkliga AI-tjänster.

Hur implementerar jag ett ramverk för AI-styrning?

Implementationen börjar med att du etablerar en tvärfunktionell styrgrupp med representanter från IT, juridik, efterlevnad (compliance) och affärsledning. När ansvaret är definierat behöver ni kartlägga er befintliga AI-användning för att förstå var riskerna finns.

Implementationen sker oftast i faser:

Utvärdera: Dokumentera alla aktiva AI-verktyg och dela in dem i risknivåer baserat på din valda standard.

Anpassa: Modifiera det valda ramverket (t.ex. NIST) så att det passar er företagskultur och branschspecifika regler.

Automatisera: Integrera styrningskontroller direkt i ert arbetsflöde (workflow). Du kan exempelvis kräva screening för bias som automatiskt stoppar en driftsättning om vissa kriterier inte uppfylls.

Vad är ett ramverk för AI-styrning?

Ett ramverk för AI-styrning (AI governance framework) är en strukturerad uppsättning regler, policyer och metoder som styr en organisations etiska, säkra och lagliga användning av artificiell intelligens. Det fungerar som de nödvändiga ramarna som dikterar hur AI-modeller utvecklas, anskaffas, används och övervakas inom hela verksamheten.

I praktiken adresserar dessa ramverk kritiska områden som datasekretess, algoritmic bias (snedvridning), transparens och ansvarsskyldighet. Utan central styrning riskerar organisationer fragmenterade silos där enskilda team introducerar "skugg-AI" utan central insyn. Genom att anta ett standardiserat ramverk säkerställer du att exempelvis marknadsteamet följer samma riskstandarder som IT-teamet när de utvecklar egna prediktiva algoritmer.

Att etablera dessa övergripande parametrar är grundläggande för alla ansvarsfulla AI-initiativ.

Vilka är de viktigaste komponenterna i AI-styrning?

De viktigaste komponenterna i ett effektivt program för AI-styrning handlar om transparens, rättvisa, riskhantering och kontinuerlig övervakning. Dessa pelare säkerställer att organisationen bygger och använder AI-system på ett säkert och etiskt sätt.

Strukturellt behöver du tydliga policyer för acceptabel AI-användning. Detta inkluderar protokoll för datastyrning som mappar exakt vilken data som matar dina modeller. En annan viktig del är förklarbarhet (explainability); intressenter måste ha möjlighet att förstå hur beslut fattas. Slutligen krävs planer för incidenthantering. Om en chatbot börjar ge felaktiga svar ska ramverket diktera exakt hur den stängs av och hur felet utreds.

Hur hänger AI-styrning ihop med EU AI Act?

AI-styrning överbryggar gapet mellan organisationens vision och de strikta juridiska krav som ställs i EU AI Act. Förordningen klassificerar AI-system baserat på risknivåer, och ett internt ramverk är det verktyg du använder för att kategorisera dina system och bevisa att du följer reglerna.

För organisationer som verkar inom EU är styrning inte längre valfritt, utan en operativ förutsättning. Akten kräver omfattande dokumentation och mänsklig tillsyn för system med "hög risk". Ditt ramverk fungerar som en blåkopia för att genomföra dessa revisioner sömlöst och skydda företaget mot böter som kan uppgå till miljontals euro.

Vilka är de främsta ramverken för AI-styrning?

De tre mest erkända ramverken för AI-styrning globalt inkluderar NIST AI Risk Management Framework (RMF), ISO/IEC 42001-standarden och de parametrar som fastställs i EU AI Act.

NIST AI RMF är mycket vanligt i USA och fokuserar djupt på egenskaper för tillförlitlighet och en metod baserad på fyra huvudfunktioner (Govern, Map, Measure, Manage).

ISO/IEC 42001 är världens första certifieringsbara standard för ledningssystem specifikt för AI, vilket är idealiskt för globala organisationer som behöver formell certifiering.

Slutligen betonar ramverk baserade på EU AI Act regelefterlevnad genom ett riskbaserat tillvägagångssätt. Ofta väljer organisationer att kombinera principer från dessa för att möta sina specifika behov.

Vem ansvarar för AI-styrning i en organisation?

Ansvaret för AI-styrning tillhör sällan en enskild person; det kräver ett tvärfunktionellt angreppssätt som leds av en dedikerad kommitté för AI-etik eller styrning. Det yttersta ansvaret vilar dock oftast på ledningsnivå, hos roller som exempelvis CDO (Chief Data Officer), CRO (Chief Risk Officer) eller en CAIO (Chief AI Officer).

I mogna organisationer definierar dessa ledare ramverket medan det operativa ansvaret fördelas utåt. Exempelvis ansvarar data scientists för tester före release, medan juridik sköter regelefterlevnad. Ett bra tips är att dokumentera rollerna i en RACI-matris så att ansvarsfördelningen är helt tydlig.

Betraktas NIST AI Risk Management Framework som en global standard?

Ja, även om NIST är en amerikansk myndighet har dess AI Risk Management Framework (AI RMF) snabbt blivit en de facto-standard globalt för multinationella företag.

Dess flexibla design gör att ramverket kan anpassas till olika internationella verksamheter. Företag använder NIST eftersom kärnan – Govern, Map, Measure, Manage – fungerar väl oavsett kulturella eller juridiska gränser. Det möjliggör ett enhetligt språk för riskhantering över hela världen.